如果做网站的内容运营,相关内容推荐可以帮助用户更快地寻找和发现感兴趣的信息,从而提升网站内容浏览的流畅性,进而提升网站的价值转化。相关内容推荐最常见的两块就是“关联推荐”和“相关内容推荐”,关联推荐就是我们常说的购物篮分析,即使用购买了某商品的用户同时购买了什么这个规则来发现商品间的潜在联系,之前有相关的文章介绍——向上营销、交叉营销与关联推荐;关联推荐是基于用户行为分析的推荐,而相关内容推荐是基于内容固有特征的推荐,只与内容本身有关,与用户的行为完全无关,所以相关内容推荐的模型是一种“冷启动”的算法,不需要任何历史浏览访问数据的支持。

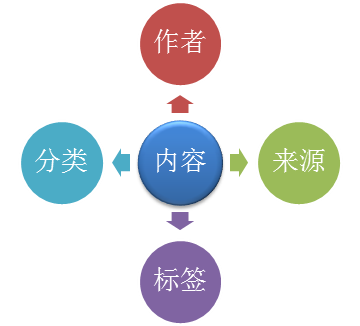

内容固有属性

相关内容推荐因为完全不借助用户浏览行为的数据,所以底层数据不依赖于网站的点击流日志,唯一的基础数据就是内容的固有属性及完整信息。我们以豆瓣网的几大块内容为例来看看对于这些内容一般包含哪些固有属性:

| 书籍 | 书名、作者、出版时间、出版社、分类、标签 |

| 音乐 | 专辑名、歌手、发行时间、发行方、风格流派、标签 |

| 电影 | 电影名称、导演、演员、上映时间、制片方、类型、标签 |

豆瓣很多地方都使用了“标签”这个词,用贴标签的形式来完成内容的分类和标识,但其实标签又分为很多种,有些标签是在内容生成时就被贴上的,有些可能是后续用户贴上去的,而且豆瓣一般为内容和标签定义了原始分类,如书籍分为文学、流行、文化……既然分类和标签内容源生就带有,那同样可以作为内容的固有属性。

还需要说明的是,这里不涉及文本挖掘和字符切分模糊匹配等问题,因此内容的标题、简介和全文不参与文本相似度的分析,虽然这些可能在构建完整的相关内容模型中不可缺少,但这里只考虑一些固有属性是否相同实现简单应用。基于上述豆瓣几类内容的属性特征,选择和整理适合分析的内容属性如下:

“作者”就是指内容的创造者,“来源”指内容的发布方或获取渠道,“分类”为内容归属的类别,“标签”可以包含对内容的各类描述信息和关键词等。这里为了能够尽可能清晰地描述整个分析模型和思路只选取了大部分内容都包含的一些属性,如果要构建更加高效的相关内容分析模型,需要更完整的内容属性,可以根据自身内容的特征进行属性的定义和选取。

KNN算法及应用

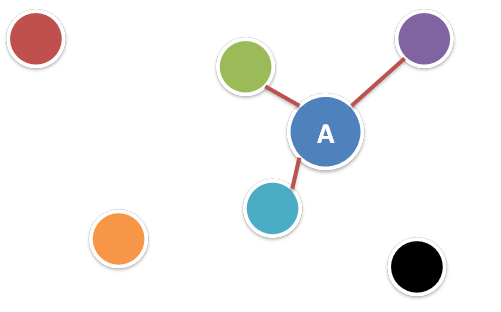

KNN(K-Nearest Neighbor algorithm),K最近邻算法,通过计算样本个体间的距离或者相似度寻找与每个样本个体最相近的K个个体,算法的时间复杂度跟样本的个数直接相关,需要完成一次两两比较的过程。KNN一般被用于分类算法,在给定分类规则的训练集的基础上对总体的样本进行分类,是一种监督学习(Supervised learning)方法。

这里我们不用KNN来实现分类,我们使用KNN最原始的算法思路,即为每个内容寻找K个与其最相似的内容,并推荐给用户。相当于每个内容之间都会完成一次两两比较的过程,如果你的网站有n个内容,那么算法的时间复杂度为Cn2,即n(n-1)/2。但是用内容固有属性有一个好处就是因为固有属性一旦创建后基本保持不变,因此算法输出的数据一旦计算好之后不需要重复计算去刷新,也就是对于网站内容而言,原有内容的数据在首次初始化之后可以不断重复使用,只要更新新增内容的数据就可以,数据的统计计算可以使用增量更新的形式,这样可以有效地减少服务器的计算压力。

相关内容模型

有了基础数据和算法的支持,我们就可以创建数据模型了。先看下基础数据的类型,作者、分类、来源和标签都是字符型,其中作者、分类、来源基本可以当做是单个值的属性,标签一般包含多个值。首先由于都是字符可以确定属性之间相似性的判定只能通过“是否相同”,无法体现数值上的差异,所以对于作者、分类、来源这几个单值属性而言,比较的结果就是一个布尔型的度量,相同或者不相同;对于标签这个多值属性可以考虑使用Jaccard相关系数,但因为每个内容标签的个数存在较大差异,使用验证后的结果并不理想,所以不考虑使用(当然,如果内容的标签个数比较固定,Jaccard相关系数是有效的)。因此,直接创建加权相似度模型如下,首先是标签的相似度分值设定:

| 相同标签数 | 图书比例 | 相似度分值 |

| 0 | 70% | 0 |

| 1 | 20% | 1 |

| 2 | 6% | 2 |

| 3 | 3% | 4 |

| >=4 | 1% | 5 |

再结合作者、分类和来源,通过加权设定总体的相似度分值:

| 属性 | 相同时分值 | 不同时分值 | 权重 | 加权分值分布 |

| 作者 | 1 | 0 | 25 | [0,25] |

| 分类 | 1 | 0 | 10 | [0,10] |

| 来源 | 1 | 0 | 15 | [0,15] |

| 标签 | [1,5] | 0 | 10 | [0,50] |

将所有属性加权相似度分值的结果相加应该分布在[0,100],分值越高说明内容间的相似度越高。对于这种简单的加权相似度评分模型,估计又有很多人要问权重是怎么确定的,确实,这里的权重并没有通过任何定量分析模型的方法去计算,只是简单的经验估计,但估计的过程经过反复地调整和优化,也就是不断地尝试调整各属性的权重系数并输出结果,抽样检验结果是否符合预期、是否有提升优化的空间。

基于上述内容间相似度的计算结果,套用KNN的原理实现相关内容推荐就异常简单了,只要根据每个内容与之比较的所有内容的相似度分值降序排列取前K个内容作为该内容的最相关内容推荐给用户就可以了。当然中间可能会涉及相同相似度分值的内容如何排序的问题(因为模型的关系分值分布可能不会很离散),建议如果相似度分值相同使用随机排序,以保证推荐结果有一定的变化,均匀内容的曝光。

好了,所有的分析流程介绍完了,好像跟前一篇的距离和相似度度量完全没有关系,其实距离和相似度度量是KNN的基础算法,因为KNN的个体相似度或邻近的距离都会选择距离度量和相似度度量中的某种方法进行计算,但这里考虑到了现实的数据情况和应用环境,并不是KNN就一定要硬套欧氏距离,其实换一种简单的方法可能反而更加适合整个模型,而且模型的最终效果可能会更理想。所以一切的数据挖掘算法的选择和使用都是基于数据模型的有效性和输出结果的效果来决定的,并不是简单的算法效果就一定不好,而高级复杂的算法一定更加有效。对了,如果你已经做了相关内容推荐,那么优化相关内容推荐这篇文章里面介绍的一些方法将是检验推荐效果的一个很好的参考。

hi, 微博上也留言了不知你是否有时间看,所以同步在这里。 图书比例这个数据对整个过程有具体的意义么?70%的的图书没有与相同标签的图书? 代表70%的相关推荐与“标签”无关。岂不是说明标签不是一个很有效的指标?

@yoyo: 嗯,我看到了,我在这里回答你吧。

我这里选取的内容固有属性一般就确定这些所有属性默认是有原始信息的。图书比例只是在相同标签赋权重时做一个分布情况的参考,70%的书籍间没有相同标签是很正常的,比如分类在“文学”和“科技”的书籍你很难让他们带有相同的标签,这两类的书籍有相关性和交集的可能性本身就很低。

谢谢解答~我是否可以这样理解:是在发现70%的没有相同标签图书,所以具有相同标签时的价值就更大了,所以相同标签数为“3”“>=4”时,相似度分值给了“4”“5”,而不是顺序给3,4分。

还有“70%的书籍间没有相同标签”我还是感觉有点不正常,同属于文学这一类的书那么多,之间都没有相同标签的吗? Thanks

@yoyo: 哦,不好意思,可能表述上有点问题,70%的相同标签是0不是指有70%的书与其它任何书都没有相同标签,是指所有的两两比较结果中相同标签数是0的结果占比是70%,所以只能说明每本书跟大部分书没有标签交集,而不是大部分书都没有跟它有标签交集的书。

博主,一般网站上看到的内容推荐系统,例如无觅网的推荐算法跟博主提的K最近邻算法是否有相通之处?

文章很好,算法也是比较简单的,要是博主能够在写一些数学方法/理论的时候引用一些相关介绍文档,我相信这样很好呗…我在找“Jaccard相关系数”就找了好久,一直想不起来…(愚人拙见,博主见谅)

@abbo: 你好,我在前一篇文章就有介绍,你可以查阅下我博客之前的文章。

@Nick Hu: 可能很多的内容推荐系统都使用了KNN的算法思路,但具体考虑的指标和影响因素及套用的距离和相似度算法可能差异会比较大,而且很多都涉及了文本挖掘技术吧。

@joegh: 明白了。。非常感谢~

自定义标签还有同义词、近义词的概念,这里要给不同的权重,比如PC和个人电脑,3C和数码产品,这是同义词,词同时还有上级概念,比如牙属于口腔,如果关注牙那口腔可能也会被关注。很喜欢这个网站,多交流:Q147981970

@陈敬明: 你好,你说的这些都是在建立完整的推荐算法时需要考虑的,但这篇文章主要是说明下思路,所以并没有去涉及自然语言和语义分析方面的东西,而且文本挖掘方面因为基本没怎么涉及,所以也不是太懂 ,那方面之后还要向你们多多学习,QQ已经加你了

,那方面之后还要向你们多多学习,QQ已经加你了

Pingback 引用通告: 网站数据分析之如何做好相关内容页的推荐 - 蓝枫博客

来学习了。不过讲的有点深奥。有点看不懂。如果有模板下载就好了,以后可以留着分析

@移动互联网: 这个没法做模板的吧,各个公司的业务环境都不一样的,了解了方法可以自己去尝试下的。

Pingback 引用通告: 谈谈网站内容的跟踪与分析